目次

はじめに:反生成AI派と生成AI肯定派との、分断と混乱のまっただ中で

AIを活用した漫画制作は、もはや一部の先進的な制作者だけの技術ではなく、誰もが使える表現手段となりつつあります。

Stable DiffusionやChatGPTなどの生成AIの進化はめざましく、従来なら、膨大な時間がかかっていた作画工程が、劇的に効率化されました。

ITライター兼、自称まんが家の筆者も、早々に生成AIまんがにシフトして作品を発表しております。

https://manga-no.com/@FURU

しかし、その急激な変化は、まんがの創作現場に深い動揺と衝撃をもたらしました。

「描く」という行為が、人間のみに許された、「神聖な領域」だと信じて疑わなかった多くのまんが家たちにとって、AIによる画像生成サービスの登場は、アイデンティティーそのものを毀損する大事件でした。

その結果、「反生成AIまんが派」と「生成AIまんが肯定派」が激しく対立することとなったのです。

そして今では双方で、批判や揶揄、報復行動が飛び交う、混沌とした状況に陥っています。

そんな中、表現の自由を守る為に、 長らく静観していた出版社や協会も、ついに生成AIに対して声明を出すまでに至りました。

ついに生成AIが「描く道具」から「裁かれる対象」になった

2025年10月、日本漫画家協会と各出版社が共同声明を発表しました。

また、声明と同時期に「ジブリがAI企業を訴えた」というニュースも出回りました。しかし、実際にはCODA(一般社団法人コンテンツ海外流通促進機構 (CODA)が2025年10月27日にOpenAIへ提出した「要望書」が発端です。

CODAの会員企業にはスタジオジブリや東映アニメーションなども含まれますので、つまりこれは「ジブリが訴訟を起こした」のではなく、あくまでも業界団体として制度整備を求めた行動でした。

CODA/OpenAI社に「Sora 2」の運用に関する要望書を提出

さて、実は、声明自体はAI技術そのものを否定していません。むしろ、こう書かれています。

「私たちは生成AI技術の進展を歓迎し、その可能性を正しく活かすことで、より多くの人々が創作の喜びを分かち合える社会が望ましいと考えています。」

(日本漫画家協会・共同声明、2025年10月31日)

「生成AIの進化により、より多くの人々が創作の喜びを分かち合い、創作物を享受できるようになる社会は歓迎されるべきですが」

(集英社、生成AIを利用した権利侵害への対応について、2025年10月31日)ただし、続く文にはこうあります。

権利者の明示的な使用許諾なく、生成 AI がアニメや漫画等の著作物を学習し、特定の作品を再現した映像等の生成・公開が可能なシステムを提供することは、著作権法の「権利者の許諾を得てから利用する」という原則に反する行為です。この原則に基づき、権利者が AI 事業者へオプトアウトを申請するのではなく、AI 事業者が権利者に対してオプトインを申請し使用許諾を得ることの徹底が、いま一度求められます。

(日本漫画家協会・共同声明、2025年10月31日)

「生成AIサービスを提供する側が、その責任のもと、早急に「オプトアウト方式」以上の実効的な侵害対策、権利者に対する救済策を打ち出さない限り、コンテンツ産業の基盤を揺るがし続ける生成AIサービスを利用した侵害のスパイラルは止まらない段階にきています。」

(集英社、生成AIを利用した権利侵害への対応について、2025年10月31日)CODAの要望内容は以下の通りです。

【要望内容】

1. Sora 2の運用において、CODA会員社のコンテンツを無許諾で学習対象としないこと

2. Sora 2の生成物に関連する著作権侵害についてのCODA会員社からの申立て・相談に真摯に対応すること

(CODA、OpenAI社に「Sora 2」の運用に関する要望書を提出、2025年10月28日)漫画家協会の共同声明は、学習・生成・公表の各段階で「権利者に必要な許諾」を求め、さらに「オプトアウトではなくオプトインの申請・許諾」の徹底に言及しています。

集英社の声明は、「生成AIサービスを提供する側が、~侵害のスパイラルは止まらない段階にきています。」と記しており、明示的な「オプトイン義務化」までは踏み込んでいません。

CODAは、今回はSora2限定の内容で、やはり「オプトイン」とまでは明言してはいません。

※ここでは、生成AI企業が、「まんが家が作品やキャラクターの無断使用を拒否」しない限り、「使ってよいものだと考えます」、というのが「オプトアウト方式」です。

「まんが家が、生成AI企業に、自分の作品やキャラクターを学習させても良い」、と許可したものが「オプトイン方式」となります。

許可をするまでは生成AI企業は、その作品やキャラクターを使っては駄目、という考えです。

この「オプトイン方式」の表明こそが、今回の最大の焦点です。

そう、世の中の多くのコンテンツは、既に生成AIによって、だいたい学習済(オプトアウト状態)となってしまっているのです。

ようするに、今回の声明や要望は、生成AIに対して、「今まで生成AIが学習していた内容を一旦全部消してもらって、許可したものだけ、再学習して欲しい 」と読み取れる要望になってしまっています。

AI開発者側にとっては非常に実装が難しく、クリエイターにとっては、自身の権利が確実に守られて朗報となります。

それだけに、今回の声明や要望は、大変大きな反響があったようです。

※AI開発者側にとって、実装が難しい件については後述致します。

実は今回は、あくまでも「声明」や「要望」であって「訴訟」ではないので、ようするに「お気持ち表明」な訳ですけど、SNSではそんな微妙なニュアンスが、全く伝わる訳がありません。

ネット界隈では、反AI派による「ついに業界挙げての、AI撲滅宣言だ!やった!」と、誤解による絶賛の嵐が吹き荒れました。

声明から読み解く、現実と解決の糸口

共同声明の意図 ― 排除ではなくルールの提示

漫画家協会と出版社の声明は、きちんと読み解けば、AIの発展を受け止めたうえで、「著作権者への敬意」を取り戻そう、というものだと言えます。

「学習・生成・公表での必要な許諾」

「学習データの透明性」

「許諾に応じた場合の適正対価」つまり「AIを使うな」ではなく、「きちんと許可を取って、正しく使え」。

AI創作を「野放図にせず、制度化しよう」という提案なのです。

しかし……。

現場の混乱 ― 「空気」が制度を先回りする

声明の直後、AIを使って漫画を制作している作家たちは困惑しました。

筆者のように、生成AIを使用して、オリジナルのキャラクターやストーリーを作成している者にとって、「これは自分の活動にも当てはまるのか?」「もう作品を発表できないのか?」と。

……実は今回の声明には、どこからどこまでの範囲で、まんが生成が「許容されるか」、もしくは「されないのか」の、「明確な基準」が一切記されていません。

そこで早速、関連各位に、AIまんがの可否・許容基準を取材しましたが、何れもが回答拒否でした。

……そして、あれよあれよという間に、SNSでは「生成AI使用=違法」という極端な定義が定着しました。

結局、制度が追いつく前に、えもいえぬ「空気」が蔓延し、AIやAI利用者を私刑するのが正義だという構図が熟成されてしまうことになったのです。

世界の動向 ― 「禁止」より「補償と透明性」へ

ちなみに海外では、AIと著作権をめぐる訴訟が急速に進んでいます。

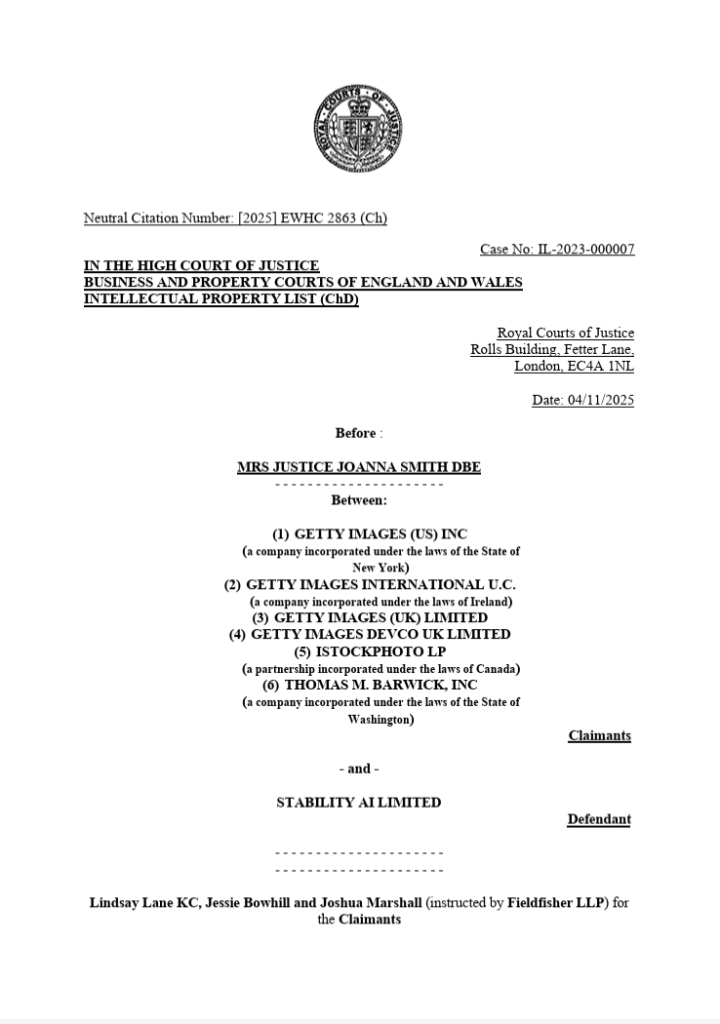

2025年11月、イギリスのロンドン高等法院が「Getty Images 対 Stability AI」の判決を下しました。

著作権侵害の中核については、Stability AIに有利と判断し(同モデルは原作品を保存・再製しないとの評価)、一方でロゴ混入等の商標部分では、Getty側の主張を一部認容しました。

結論は「部分勝訴/部分敗訴」ですが、著作権の主要論点はAI企業側に有利な内容であったという論調とされています。しかしSNS上では、反AI派は、むしろ生成AI側こそが敗訴だと主張しました。

ちなみにデンマークでは、出版社団体DPCMOがOpenAIに対し、学習への無断利用を理由に対価支払いとデータ開示を求める法的手段に踏み出したと報じられています(2025年7月)。

「記事や写真を無断で学習に使用した。」

「使用料の支払いと学習データの透明化を求める。」

(要約)欧州では、AI Act(欧州AI規制法)の透明化義務や、DSM指令4条(TDM=AIや研究で使うために大量のデータを分析する行為の例外と権利者の権利予約)を土台に、「透明性+(合意に基づく)報酬」へ舵を切る議論が進行中と見られています。

欧州議会の研究報告も、公平なライセンスモデルや、オプトアウト枠組の見直しを提案しています。

オプトインは「理論上は正しい」、しかし現実には成立しえないであろう理由

現状:AIはすでに「オプトアウト」で動いている

現時点で稼働している主要AIモデル(OpenAI、Google、Anthropic、Stability AIなど)は、すべてオプトアウト方式──すなわち「拒否されない限り学習してよい」──を前提に設計されています。

これは一部の慣習ではなく、事実上の国際標準になっています。

一方、漫画家協会や出版社が声明で求めているのは、オプトイン方式──

すなわち「権利者の事前許諾がなければ、学習すらしてはいけない」という仕組みです。

しかし、これは感覚的にはまっとうなものの、現実には以下のような構造的な問題が存在します。

- 作品はSNSや転載サイトを通じて拡散し、制作者の管理を離れてしまっている。

- すでに学習済みのAIモデルには、学習データを後から削除する機能が、そもそも存在しない。

- 「noai」「robots.txt」などの拒否用の 公式メタタグ・HTTPヘッダ・robots仕様 が、業界共通で確立されていない。

そもそもIPTC/国際新聞電気通信評議会が、「there is no universal mechanism to add a ‘generative AI opt-out’ to robots.txt.(robots.txt に「生成AI向けのオプトアウト」を追加するための普遍的な仕組みは、存在しない。)」と述べている。

AIクローラが、そのルールに従う保証もない。 - 日本の著作権法30条の4は、「情報解析目的」であれば、著作権者の利益を不当に害することがなければ、「著作権者の許諾なしに一定範囲の利用を認めている」とされている。

著作権法 第30条の4

著作物は、次に掲げる場合その他の当該著作物に表現された思想又は感情を自ら享受し又は他人に享受させることを目的としない場合には、その必要と認められる限度において、いずれの方法によるかを問わず、利用することができる。ただし、当該著作物の種類及び用途並びに当該利用の態様に照らし著作権者の利益を不当に害することとなる場合は、この限りでない。

1.著作物の録音、録画その他の利用に係る技術の開発又は実用化のための試験の用に供する場合

2.情報解析(多数の著作物その他の大量の情報から、当該情報を構成する言語、音、影像その他の要素に係る情報を抽出し、比較、分類その他の解析を行うことをいう。第47条の5第1項第2号において同じ。)の用に供する場合

3.前二号に掲げる場合のほか、著作物の表現についての人の知覚による認識を伴うことなく当該著作物を電子計算機による情報処理の過程における利用その他の利用(プログラムの著作物にあつては、当該著作物の電子計算機における実行を除く。)に供する場合この条文により、AI学習行為そのものは、「情報解析目的に該当しうるのではないか」と、みなされる可能性が高いとされています。

協会や出版社の声明は、「権利者の同意を尊重せよ」というメッセージとしては素直に理解できます。

しかし、すでにオプトアウト前提で構築された巨大AIモデル群に対し、これからオプトインを義務化するのは、技術的にも法的にもほぼ実現不可能ではないかと思われます。

もし本気でオプトインを徹底するなら、

既存AIをすべて一旦全部初期化させて、再学習の為に、データの出典を、一件ずつ権利者確認しなければならない。

これは現行の技術では、不可能に近いコストと工数を要します。

したがって、現実的な落としどころはこうではないでしょうか。

- 過去の学習分:削除や再学習は困難なため、都度、個別対応を協議。

- 今後の学習分:事前許諾(オプトイン)を原則とし、透明性を強化。

つまり、「オプトインを未来のルールとして整える」方法しかありません。

声明のように「すべてのAI学習にオプトインを」と主張しても、すでに回り始めた巨大システムを止めることは、現実問題として、訴訟を起こして、現在のAIサービスを全面的にストップさせない限り、まず実現は出来ないでしょう。

とどのつまり、「オプトイン」は、理想として掲げるに留まり、現実の運用とは乖離しているのです。

まだ日本ではAI企業への訴訟が行われていないように見えますが、もしどなたかが提訴をする場合には、著作権法 第30条の4の壁をどう乗り越えるかが、勝算の鍵となることでしょう。

現実的な解決策ー生成AIとの共存策を制度化するために

では、創作者・出版社・AI企業が歩み寄るために何ができるのか。今すぐ取り組める具体案をいくつか提言してみました。

出版社・協会:透明性レベルでAIを区分する

各AIを、「使っていい/駄目」で一刀両断せず、透明性の段階でAIを区分して、提示をする方式が現実的です。

| レベル | 内容 | 対応策 |

| レベル1 | 学習元不明・免責条項あり | 公募・連載投稿は制限(要申告) |

| レベル2 | 公開データ中心・利用規約明示 | オリジナル限定なら利用可 |

| レベル3 | 許諾済・透明データセット使用 | 制限なし、商用利用可 |

このように各AIに対して、明確な基準を提示してもらえれば、クリエーターもAIツールを選択しやすくなります。直ちに制定してほしいですね。

AI事業者:日本向け「ホワイトリスト」と包括契約の導入

AI企業と日本の権利団体は、直ちにお互いに協力し、「許諾済みデータセット」をリスト化したホワイトリスト制度を作るべきです。

- 学習素材の出典を明示(CC0/ライセンス契約済など)

- 権利団体と包括契約(使用料の自動分配)

- 日本法準拠モード(オプトイン強化)を搭載

これにより、利用者は「安全なAIかどうか」を選択できます。

創作者はAI利用の「自衛ルーチン」を持つ

AIを使う側も、透明性を示す手段を持つ必要があります。

- 制作記録の保存:プロンプトや修正過程をスクリーンショットやテキストなどで残す。

- 公開時の表記:「AI補助利用あり」と明示する。

- 自己チェックリスト:「構図類似なし」「修正率50%以上」など。

これを協会や出版社が統一規格としてテンプレート化すれば、AI使用者が堂々と名乗れる環境を作れます。(個人的にも、生成時のプロンプトや生成ルールは、極力保存するようにしています。)

制度設計:二段階許諾モデルの構築

- 一次許諾(学習):権利者がAI学習に使ってよい範囲を登録。

- 二次許諾(生成・利用):生成物が商業利用される際に再確認。

音楽著作権の管理方式(JASRAC方式)に近く、AI事業者が自動処理しやすい仕組みです。

欧州のCollective Licensingモデルとも整合します。

教育・公募現場:AI使用を「別カテゴリ」で評価

AI作品を排除せず、「AI利用枠」として明示的に扱います。

- 学校教育では「技術研究枠」扱い。

- 公募では「AI補助部門」を設け、構成力や指示設計を評価対象にする。

これで、「AI使用=不正」ではなく「AI使用=別の創作形態」として理解できます。

反AI派、AI肯定派の立場別にみる主張整理

| 立場 | 主張の軸 | 現実的課題 | 折衷の方向性 |

| 反AI派 | 権利保護・伝統的作画の尊重 | 技術の不可逆性に追いつけない | 許諾・報酬の制度設計 |

| 肯定派 | 技術の民主化・創作の自由 | 法的整備の遅れ・倫理的不安 | 透明性を持った利用 |

| 出版社・協会 | 著作権の尊重と信頼維持 | 運用指針の不明確さ | 段階的な許諾制と公開指標 |

| AI企業 | イノベーションと市場拡大 | 再学習・権利管理コスト | 包括契約・透明化 |

| 創作者 | 表現の拡張・制作効率 | 誤解と風評リスク | 利用履歴と明示で信頼を確保 |

まとめ:AIは創作の敵ではなく、むしろクリエーターの味方である

今回の声明や要望書は、拒絶ではなく制度設計への要請の筈でした。

しかし、そこには「実際の運用手順」「基準」 がすっぽりと抜けてしまっていた為に、「お互いがWinWinになるための議論」が、「AIの利用を躊躇わせるだけの主張」に拗れてしまいました。

実に嘆かわしいことです。

AIはもう、現場に定着した道具です。

AIを全面禁止しても地下に潜るだけです。

映画「ザ・クリエイター/創造者」の世界のよう に、仮に日本が完全AI禁止に舵を振り切ったとしても、他国ではAIを積極的に使われて、技術格差が広がり、国際競争力が下落するのが関の山です。

ならば、心おきなく、AIを使うためのルールを早急に構築するほうが、より建設的です。

AIは人間の代わりではなく、「想像を広げるための道具箱」として存在できます。

それを安全に使うための、オプトインや透明性の確保の諸策は、必要な「道具箱の鍵」にすぎません。

創作と制度の間にある「誤解の壁」を越えられるかどうかは、結局、私たちがその手順を、明確な形にできるかにかかっています。

禁止ではなく、共存の設計へ。

その一歩を、今こそ「描き直す」時期なのではないかと思います。

参考文献

漫画家協会WEB/生成AI時代の創作と権利のあり方に関する共同声明

https://nihonmangakakyokai.or.jp/archives/news/20251031

集英社/生成AIを利用した権利侵害への対応について

https://www.shueisha.co.jp/wp-content/uploads/2025/10/shueisha20251031.pdf

CODA/OpenAI社に「Sora 2」の運用に関する要望書を提出

https://coda-cj.jp/news/2577/

euro news,/Danish publishers sue OpenAI after failing to strike rights deal

https://www.euronews.com/next/2025/07/01/danish-publishers-sue-openai-after-failing-to-strike-rights-deal

LAW SOCIETY/gazette/Danish media publishers to sue OpenAI

https://www.lawsociety.ie/gazette/top-stories/2025/july/danish-media-publishers-to-sue-openai/

JDSUPRA/European Parliament’s New Study on Generative AI and Copyright Calls for Overhaul of Opt-Out Regime

https://www.jdsupra.com/legalnews/european-parliament-s-new-study-on-3354884

Hogan Lovells/Copyright provisions in the AI Act: generative AI, transparency, and data mining

https://www.hoganlovells.com/en/publications/copyright-provisions-in-the-ai-act-generative-ai-transparency-and-data-mining

Europian Pariament/Generative AI and Copyright – Training, Creation, Regulation

https://www.europarl.europa.eu/RegData/etudes/STUD/2025/774095/IUST_STU%282025%29774095_EN.pdf

on copyright and related rights in the Digital Single Market and amending Directives 96/9/EC and 2001/29/EC

https://eur-lex.europa.eu/eli/dir/2019/790/oj

Zelo LAW SQUARE/弁護士が解説!著作物のAI学習利用に関する海外制度と最新動向(2023年)

https://zelojapan.com/lawsquare/35949

IPTC/IPTC Generative AI Opt-Out Best Practice Recommendations

https://iptc.org/std/guidelines/data-mining-opt-out/IPTC-Generative-AI-Opt-Out-Best-Practices.pdf

著作権法第30条の4

https://ja.wikibooks.org/wiki/著作権法第30条の4

Publisher’s Licensing Services/Collective licensing

https://www.pls.org.uk/collective-licensing/what-is-collective-licensing/

おまけまんが